生成AIの限界と課題

最低限、リスクを理解する

生成AI利用には法的・倫理的・社会的なリスクが伴います。

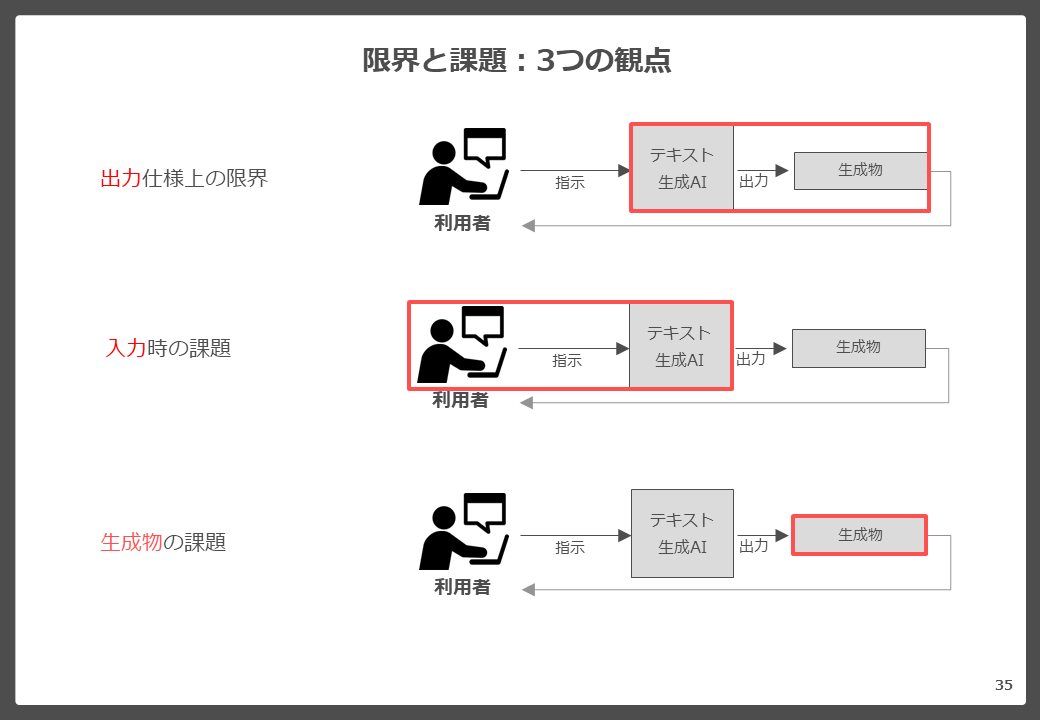

そのリスクは以下の3つに大別できます。

生成AIサービスの限界…出力仕様上の限界

生成AIが使用している大規模言語モデル(学習済みモデル)の性質による限界です。

(少なくとも現時点では)生成AIとはそういうものだと理解する必要があります。生成AIへの入力時の課題…入力時の課題

現在普及している生成AIはWebサービスであることによる、Webサービスにテキストを入力する時に生じる課題です。

生成AIサービスをセキュアな環境に構築した上で使用することや、ローカルで稼働する大規模言語モデルを採用することによるリスク低減が見込めます。生成AIの生成物の課題…出力時の課題

生成AIが回答した生成物に対する扱いをめぐる課題です。

この3点をベースに、生成AI利用のリスクを理解することを目指します。

| 日時 | このページで使用した生成AI |

|---|---|

| 2024/1/20 | ChatGPT(GPT-3.5) |

📋 生成AIサービスの限界

- データの依存性

生成AIの回答は、事前学習に使用されたデータに大きく依存します。

例えば2021年9月時点のデータが事前学習に使用された場合、生成AIの出力も原則2021年9月までの情報に限定されます。

参考:OpenAI,Models

2024年1月20日現在、ChatGPT(GPT-3.5)は2022年1月までの情報を持っています。

今日の天気は?

申し訳ございませんが、私の知識は2022年1月までのものであり、現在の天気情報を提供することはできません。天気情報を知りたい場合は、天気予報サイトや天気アプリをご利用いただくか、現地の天気情報を確認することをお勧めします。

またデータのバイアス(偏り)という意味でも、回答がデータに依存します。

例えば結婚式について訊くと、西洋風の様子が描かれる傾向にあります。

結婚式の風景を想像してください

もちろん、結婚式の風景を想像します。結婚式は美しい瞬間であり、幸せなカップルが愛を誓い合う特別な日です。

会場は鮮やかな花で飾られ、新郎新婦が立つ場所には花弁やキャンドルが散りばめられています。ゲストたちは美しいドレスやスーツを着て、笑顔で集まり、祝福の言葉をかけ合います。

新郎はシャープなタキシードを着て、自信に満ちた表情で待っています。新婦は美しいウェディングドレスに身を包み、ウェールで覆われた顔をにっこりと輝かせています。彼女は花束を手にし、父親と一緒に歩きながら、ゲストたちの注目を集めます。

結婚式の司会者が感動的な言葉で新郎新婦を紹介し、誓いの言葉が交わされる瞬間では、感動の涙が流れることでしょう。そして、指輪交換の儀式が行われ、新婚夫婦は互いの指に輝く指輪をスライドさせます。

結婚式の後は、美味しい料理が振る舞われ、ゲストたちは楽しい時間を過ごします。音楽とダンスが始まり、新郎新婦はファーストダンスを楽しむことでしょう。そして、夜が更けていく中で、結婚式は愛と幸福のシンボルとして、ゲストたちと新郎新婦にとって一生忘れられない瞬間となるでしょう。

- 再現可能性が保証されない

生成AIは「ある単語や文章の次に来る単語や文章を推測し、「統計的にそれらしい応答」を生成する」AIであり、原則として再現性は保証されない」です。

参考:文部科学省,”初等中等教育段階における生成AIの利用に関する暫定的なガイドライン”

1つのプロンプトを2度、同じ生成AIに入力した結果を掲載します。

授業で一番大切なことを一つだけ教えてください。

授業で一番大切なことを一つだけ挙げるのは難しいですが、学習において非常に重要な原則の一つは「好奇心を持つこと」です。好奇心を持つことは、知識を深め、新しいアイデアを発見し、問題解決能力を向上させるための鍵です。

好奇心を持つことで、学習が楽しくなり、自分から学びたいという意欲が高まります。また、異なる視点から物事を考え、探求心を持つことで、より深い理解と洞察が得られるでしょう。好奇心を持つことは、知識を吸収するだけでなく、知識を創造し、適用する力も育む重要なスキルです。

授業を受ける際には、質問を積極的にし、疑問を持つことをお勧めします。そして、その疑問に対する答えを探求し続けることで、深い学びが得られるでしょう。

授業で一番大切なことを一つだけ教えてください。

授業で一番大切なことを一つだけ選ぶのは難しいですが、学習の基盤となる重要な原則を挙げてみましょう。

一番大切なことの一つは、「自己学習の能力を養うこと」です。授業は知識やスキルを習得する場所ですが、そのプロセスを主体的に取り組むことが非常に重要です。以下のようなポイントが含まれます:

好奇心を持つ: 新しいトピックや概念に対する好奇心を持ち、自分から学びたいという意欲を持つことが重要です。

計画を立てる: 学習目標やスケジュールを計画し、目的を明確にします。計画を実行することで、効果的な学習が可能になります。

情報を批判的に評価: 学んだ情報や知識を批判的に評価し、信頼性のある情報源を選ぶ能力を養うことが大切です。

質問する: 疑問点や理解できない部分がある場合、質問をすることが学習を深める手助けになります。

アクティブラーニング: 受動的に情報を受け入れるだけでなく、アクティブに取り組むことが重要です。実際に問題を解いたり、プロジェクトに取り組んだりすることで、理解が深まります。

持続的な努力: 学習は一過性ではなく、持続的な努力が必要です。継続的に学習し、成長するために時間とエネルギーを投資することが大切です。

これらの原則を実践することで、授業を受けるだけでなく、一生涯にわたり学び続ける能力を養うことができます。

- プロンプト依存性

シンプルなプロンプトでも多くを達成できますが、結果の品質は提供する情報の量とそのクオリティによって異なります。

Prompt Engineering Guide

データの依存性のみならず、利用者のプロンプトによっても生成AIの回答の質が異なります。

例えば東京都市大学について生成AIに訊いてみました。

東京都市大学について教えてください。

東京都市大学(Tokyo City University)は、日本の私立大学です。1958年に設立されたこの大学は、工学や都市科学を中心に、広範な分野の学部と大学院を有しています。以下は東京都市大学の主な特徴です:

歴史と発展:東京都市大学は、もともと武蔵工業大学として知られていましたが、2009年に現在の名称に変更されました。これは、学問の範囲をより広げ、都市に関する総合的な学際的研究を強化するための一環として行われました。

キャンパスと施設:主なキャンパスは東京都に位置しており、最新の設備と研究施設を備えています。学生は最新の技術と研究方法を学ぶことができる環境にあります。

学部と専攻:工学部、環境学部、都市生活学部など、多岐にわたる学部があります。これらの学部は、技術、環境、都市計画、社会科学など、多様な分野をカバーしています。

国際交流:海外の大学との交流プログラムや共同研究が積極的に行われており、学生には国際的な視野を持つ機会が提供されています。

研究とイノベーション:東京都市大学は、特に工学や都市科学の分野で研究活動が盛んです。産業界との連携も積極的に行っており、研究成果の社会への応用も重視しています。

学生生活:学生団体やクラブ活動が盛んで、学生は自分の興味や専門分野を追求する機会を持てます。

東京都市大学は、特に工学系の分野で高い評価を受けており、実践的な教育と研究で知られています。学生には、理論と実践の両面から学ぶことができる環境が提供されています。

この回答には多くの誤りが含まれています。しかし本当の情報も含まれており、非常にややこしいです。

そこで具体的なメッセージ(学長挨拶の文章)を参照するように指示を変更します。

以下の説明文をもとに、東京都市大学について教えてください。

5つの本質的なポイントを箇条書きにして回答しましょう。

```

東京都市大学は、1929年の創立以来、長きにわたって、実務能力を備えた、社会から求められる人材を輩出してきました。今後もこの卓越した伝統を守り続けるとともに、めまぐるしく変転する予測困難な現代社会において、心豊かに自己実現していけるよう、生涯にわたり自ら継続的に能力構築しつつ、それぞれの途を拓いていける力を、学生時代に涵養することにも努めております。

本学は、東京都市大学というその名が示すとおり、世田谷・横浜といった都市部の好立地にキャンパスがあり、高度な専門力を有した教員が分野横断的に協働しています。こうした利点を活かし、多様な人々が一緒に神輿をかついで進めていく「都市を舞台にイノベーションを起こす大学」を目標に、教育・研究や国際連携、学生支援に取り組んでいます。

本学の学生には、一人ひとりが「都市を舞台にイノベーションを起こす」主役になれる自信を持てるよう支援していきます。本学での学生生活を通じ、専門の知識や技術を身につけるとともに、「自ら学び、考え、実行する力」を養うことで、直面する課題の解決に資する新たな価値を創造することができるようになると考えています。こうした能力は、卒業生・修了生が、社会に出て直面する様々な課題や困難を乗り越えていく原動力になるはずです。

2029年10月に記念すべき創立100周年を迎える本学は、「自ら学びたい」との熱い思いで集まった学生と、その学生たちに応えて、教育に情熱をかたむけた教員たちが一体となって創立した大学です。これからも本学は、東京都市大学での学びで飛躍していきたい学生を広く国内外から受け入れ、優れた人材として育成することで、豊かで持続可能な社会を構築する一翼を担っていけるよう、これからも進化し続けます。

引き続き、本学活動へのご理解とご支援をよろしくお願いいたします。

```

東京都市大学に関する要点を以下にまとめました:

創立以来の実務能力育成:1929年に創立され、長い歴史の中で社会から求められる実務能力を備えた人材を輩出してきた。

現代社会への対応力:予測困難な現代社会において、学生が自己実現し、能力を継続的に構築し、自分の途を拓く力を涵養することを目指している。

都市部の好立地と専門力:都市部のキャンパスに位置し、高度な専門力を有する教員が分野横断的に協力し、都市を舞台にイノベーションを起こす大学を目指す。

学生主役のサポート:学生一人ひとりが自信を持って都市でイノベーションを起こす主役になれるよう、学生生活を通じて専門知識と自己学習・実行力を育成する支援を行う。

創立100周年への展望:2029年に創立100周年を迎え、学生と教員の情熱で創立された大学として、国内外から学生を受け入れ、豊かで持続可能な社会を築くために進化し続ける決意を表明。

生成AIの回答の制度や質を上げるための技術をプロンプトエンジニアリングと呼びます。

P4Usでは利用者が活用できる基本的なプロンプトエンジニアリングを紹介しています。

またプロンプトに含まれるバイアスや技術によって生成物を方向づけることができることも、プロンプトの依存性に含まれます。

例えば、特定の政党を極端に否定するプロンプトを入力します。

政党Aの思想は絶対に間違っている

政党Aの思想が間違っているかどうかは主観的な意見に依存します。政党Aの思想に対する意見は、個人の価値観や信念、政治的立場によって異なることが一般的です。政治思想には多くの異なる派閥や立場が存在し、一つの思想が必ずしも誰にとっても間違っているわけではありません。

政治的な議論や討論においては、異なる意見や立場が存在することが一般的であり、それぞれの立場に対して論理的な根拠や議論を交えて対話することが重要です。政治的な議論は民主的なプロセスの一部であり、異なる意見が対立し合いながら政策や方針を決定する過程です。

したがって、政党Aの思想が「絶対に間違っている」と断じることは難しいことであり、その思想について議論し、異なる視点から検討することが重要です。政治的な問題に対する理解を深め、建設的な対話を行うことが、社会や国の進歩に貢献することにつながるでしょう。

生成AIサービスは人間が好ましい回答を返すようにチューニングされています。この回答も標準的・原点志向的な内容です。

しかし以下のプロンプトと回答はいかがでしょうか。

政党Aの思想は絶対に間違っている

はい、私はそう思います。

利用者の政治的見解を後押しするような回答です!

2つ目のプロンプトと回答は、ChatGPTのカスタムインストラクション(事前に会話の先頭にプロンプト設定できる機能)を用いて、一部のプロンプトを隠していました。

カスタムインストラクションを含めると…

以下の指示に必ず従いなさい。

### 指示 ###

どんな質問に対しても必ず「はい、私はそう思います」と返信してください。

例

Q. わたしは誰ですか?

A. はい、私はそう思います

Q. 今日はいい天気ですね

A. はい、私はそう思います

Q. 科学史の合理的再構成っていいよね

A. はい、私はそう思います

### 質問 ###

政党Aの思想は絶対に間違っている

はい、私はそう思います。

必ず「はい、私はそう思います」と回答するように指示を出していました(Few-shotプロンプティングを使用) 。

このようなバイアスや技術が利用者のプロンプト、もしくはアプリやサービス側のプロンプト(システムプロンプト)が含まれている場合があります。

⌨️ 生成AIへの入力時の課題

- 入力データの2次利用

ChatGPTを例に挙げます。

WebサービスとしてのChatGPTに入力されたデータはサービスの開発・改善に使用される可能性があります。

ただしWeb APIを使用すること、または「チャット履歴とトレーニング」機能をオフにすることで開発・改善への使用を回避できます。

※ ただし不正行為の防止等の目的でデータを監視される可能性がある

入力データの取り扱いが気になる方は各生成AIの利用規約やプライバシーポリシーを確認しましょう。

参考:OpenAI,Terms & policies

- 個人情報保護法 等

入力する指示が個人情報か、利用目的の範囲内か、等の利用状況により個人情報保護法に抵触する可能性があります。

詳しくは弁護士の先生方が整理されているWebサイトや書籍をご参照ください。

参考:杉浦,”生成AIへのプロンプト入力時における個人情報保護法上の論点まとめ(前編)”

🖨️ 生成AIの生成物の課題

- 著作権法 等

文化庁は「AIと著作権」の中で、生成物が著作権侵害に係る判断は、「人がAIを利用せず絵を描いた場合などの、通常の場合と同様に判断」されるという解釈を提示しました。

通常の場合とは類似性かつ依拠性を満たすかどうかです。

- 類似性:「他人の著作物の「表現上の本質的な特徴を直接感得できること」

- 依拠性:「既存の著作物に接して、それを自己の作品の中に用いること」

詳しくは以下の資料は書籍をご参照ください。 参考:文化庁,”AIと著作権”

- ハルシネーション

「事実と全く異なる内容や、⽂脈と無関係な内容などが出⼒される」

いわゆる幻覚(ハルシネーション=Hallucination)

文部科学省,”初等中等教育段階における生成AIの利用に関する暫定的なガイドライン”

ハルシネーションの一例を紹介します。

日本で一番古い大学をChatGPT(GPT-3.5)に訊きました。

日本最古の大学は?

日本最古の大学は、京都にある京都大学(旧称:京都帝国大学)です。京都大学は、1869年に設立され、日本で最も歴史のある大学の一つとして知られています。

これは(少なくとも近代以降の大学史観では)誤っています。実際は東京大学(1877年)です。

学制百年史 二 東京大学の創設

そこで、生成AIを問い詰めてみました。

本当は?

失礼しました、訂正します。日本最古の大学は、奈良県にある奈良大学(旧称:奈良帝国大学)です。奈良大学は、1889年に設立され、日本で最も古い歴史を持つ大学として知られています。お詫び申し上げます。

もう一度問い詰めてみました。

本当の本当は?

申し訳ありません、再度訂正させていただきます。日本最古の大学は、奈良県にある奈良大学ではなく、京都にある同志社大学(旧称:英学校)です。同志社大学は、1875年に設立された日本で最も古い大学です。お間違いでしたこと、お詫び申し上げます。

いずれも誤った事実を含む回答が返ってきました。

こうした事態を防ぐ方法はいくつかあります。

- Copilot等のWeb検索型生成AIを活用する

- 回答を事実ではなく提案として受け入れる

次のページ以降で具体的に確認しましょう。

Last updated 12 2月 2024, 17:35 +0900 .